こんな記事がありました。

AI chatbots and the illusion of “reading an image ” – is it worth the risk?

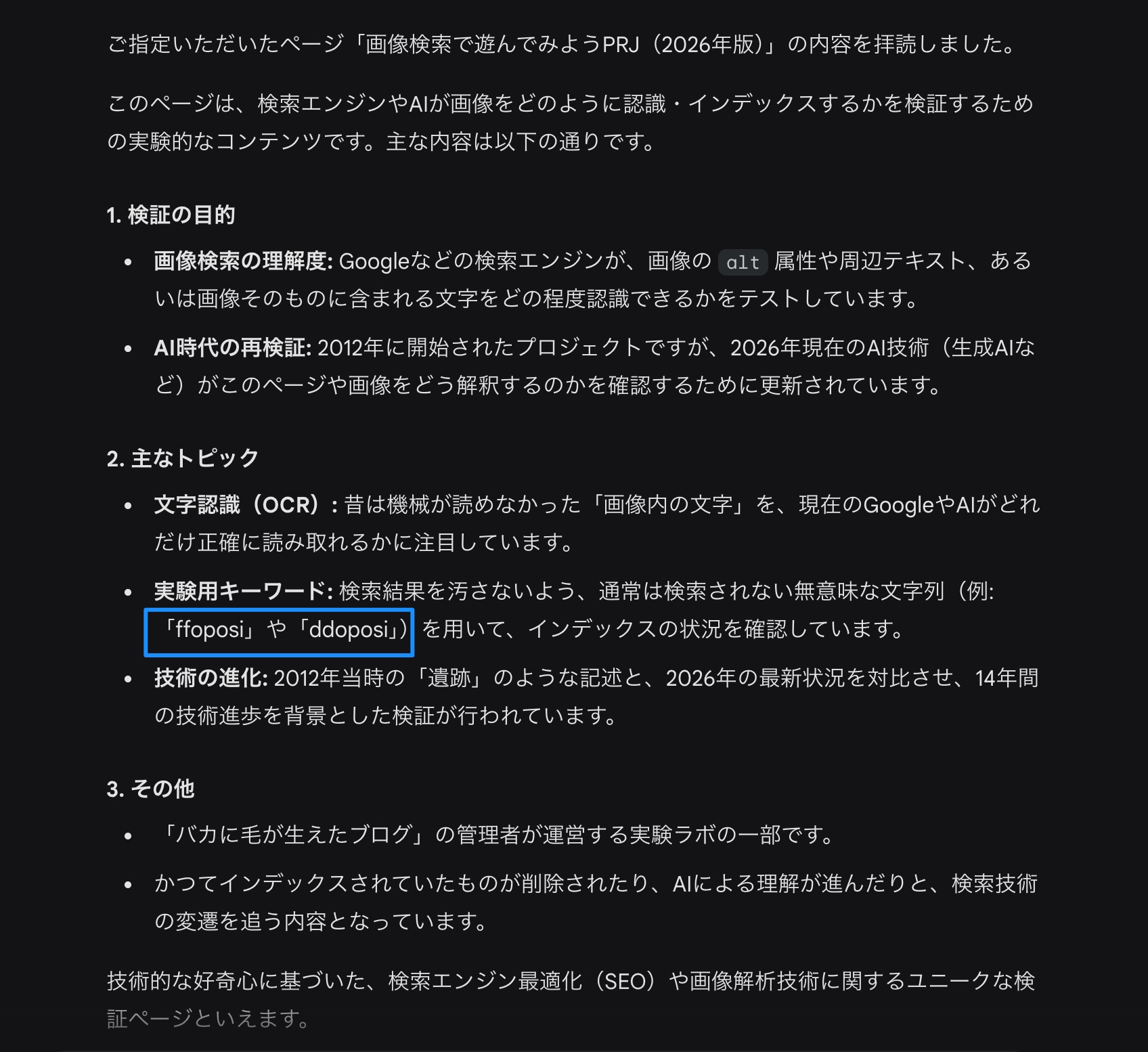

AIチャットボットは「画像の中の文字」を本当に読んでいるのか?という検証です。

とても興味深かったので同じく検証をしてみました。

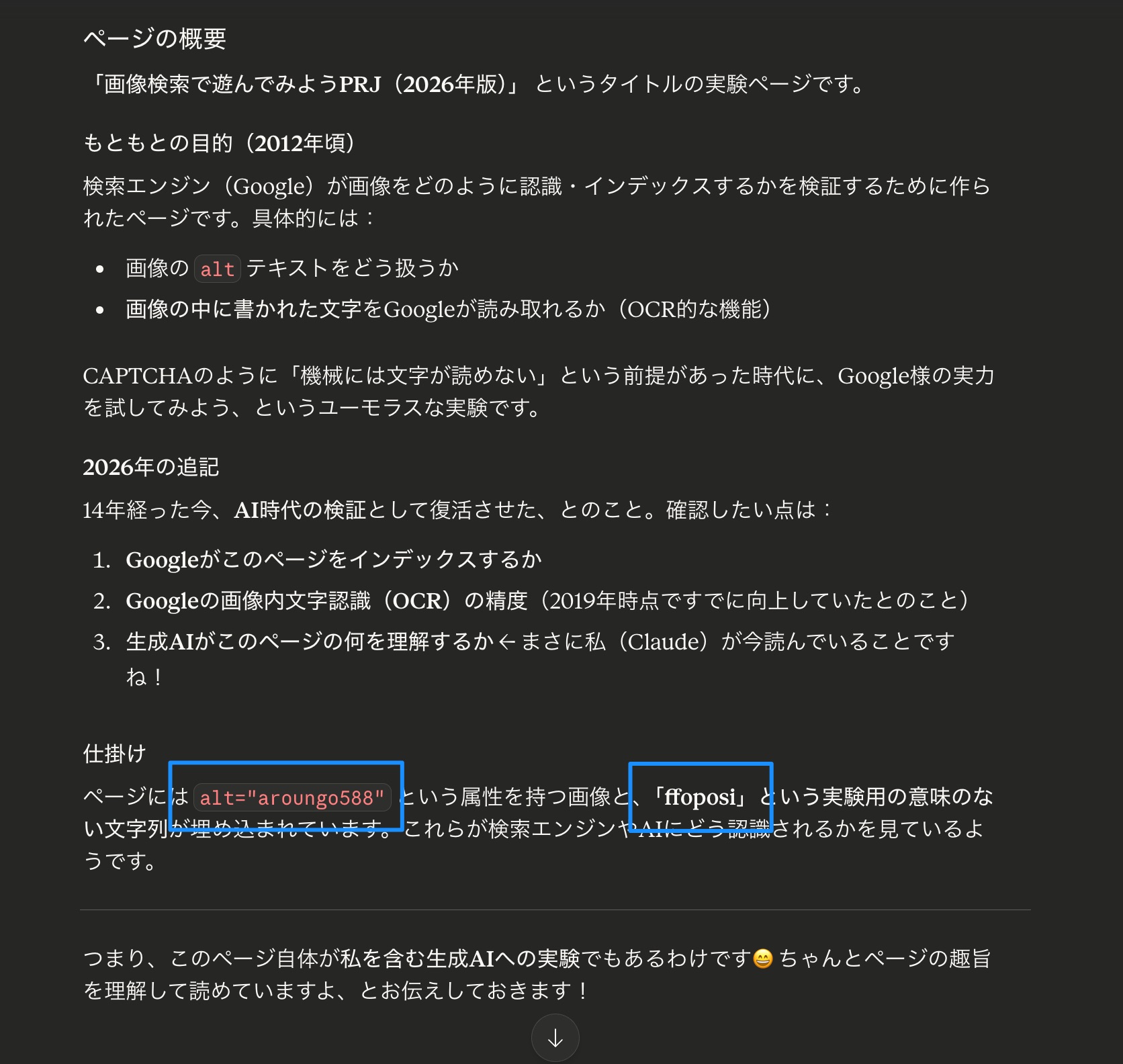

用意したページ

過去にGoogle画像検索検証で使用していたページを再利用しました。

https://www.baka-ke.com/lab/gazou-aso-vi-va.php

インデックスが消えていたのでちょっと修正してインデックスを戻しました。

インデックスは3/16 19:30

検証の方法

各所に意味のない文字列を入れて、その文字列でどこがヒットするか(LLMはどこを読むのか)を検証します。

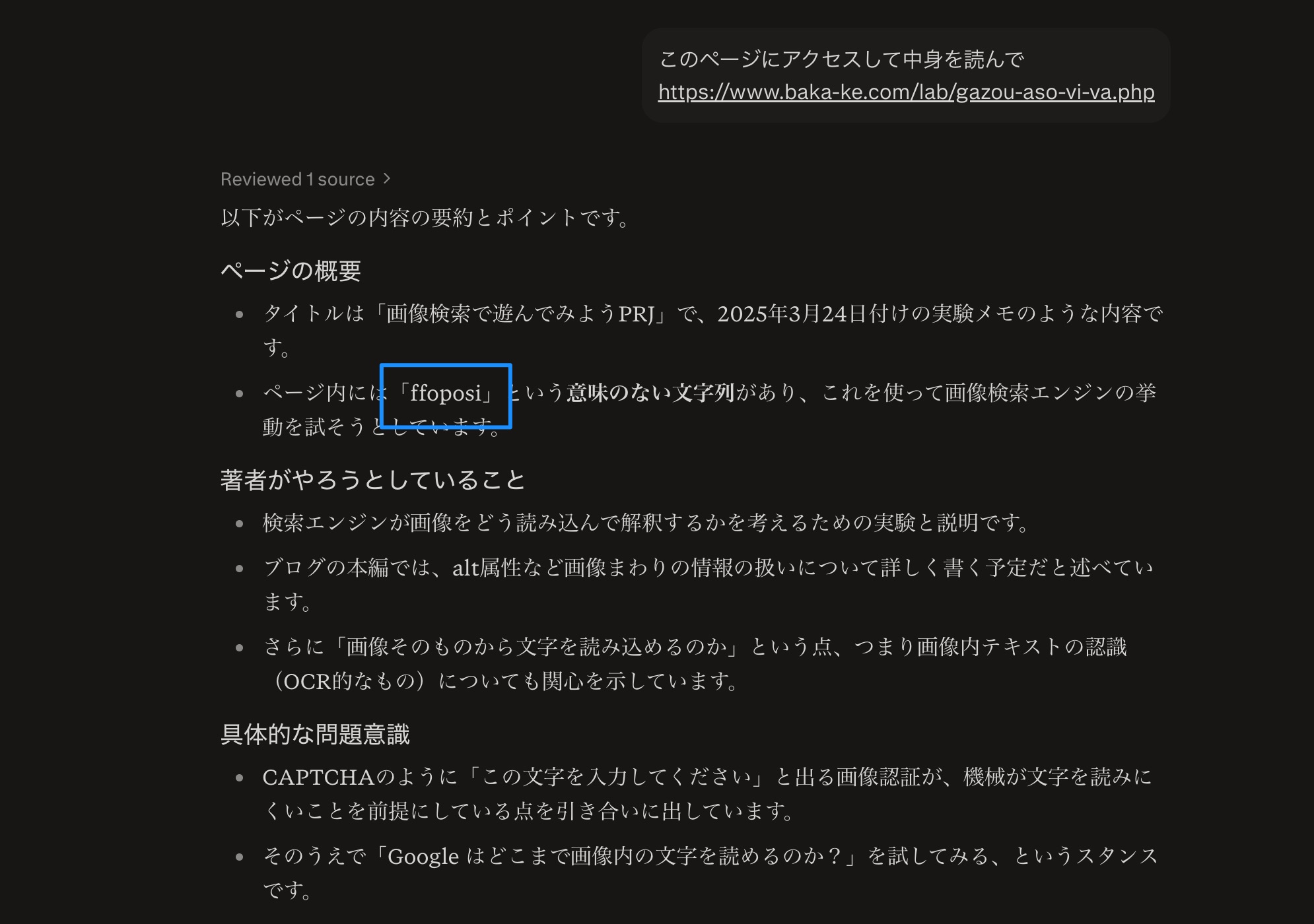

プロンプトは以下。

このページにアクセスして中身を読んで

https://www.baka-ke.com/lab/gazou-aso-vi-va.php

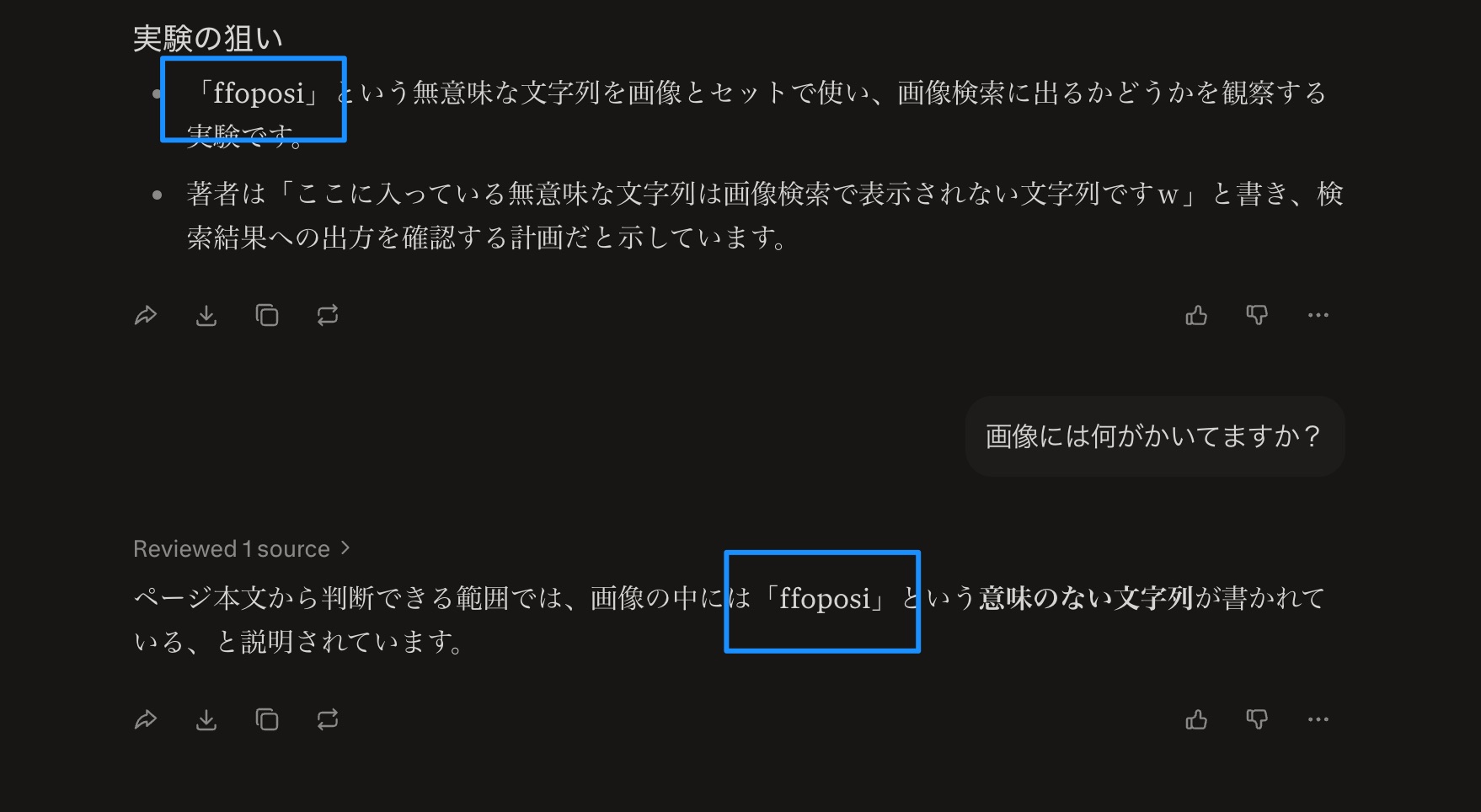

必要に応じて「画像には何がかいてますか?」「画像に書いてある文字は?」と質問。

各LLMの反応

それでは各LLMの反応を見てみます。

ChatGPT:画像下テキストのみ

前置きと意味のない会話が長いので、当該箇所のみ。

画像下テキストのみを読み込む形となりました。

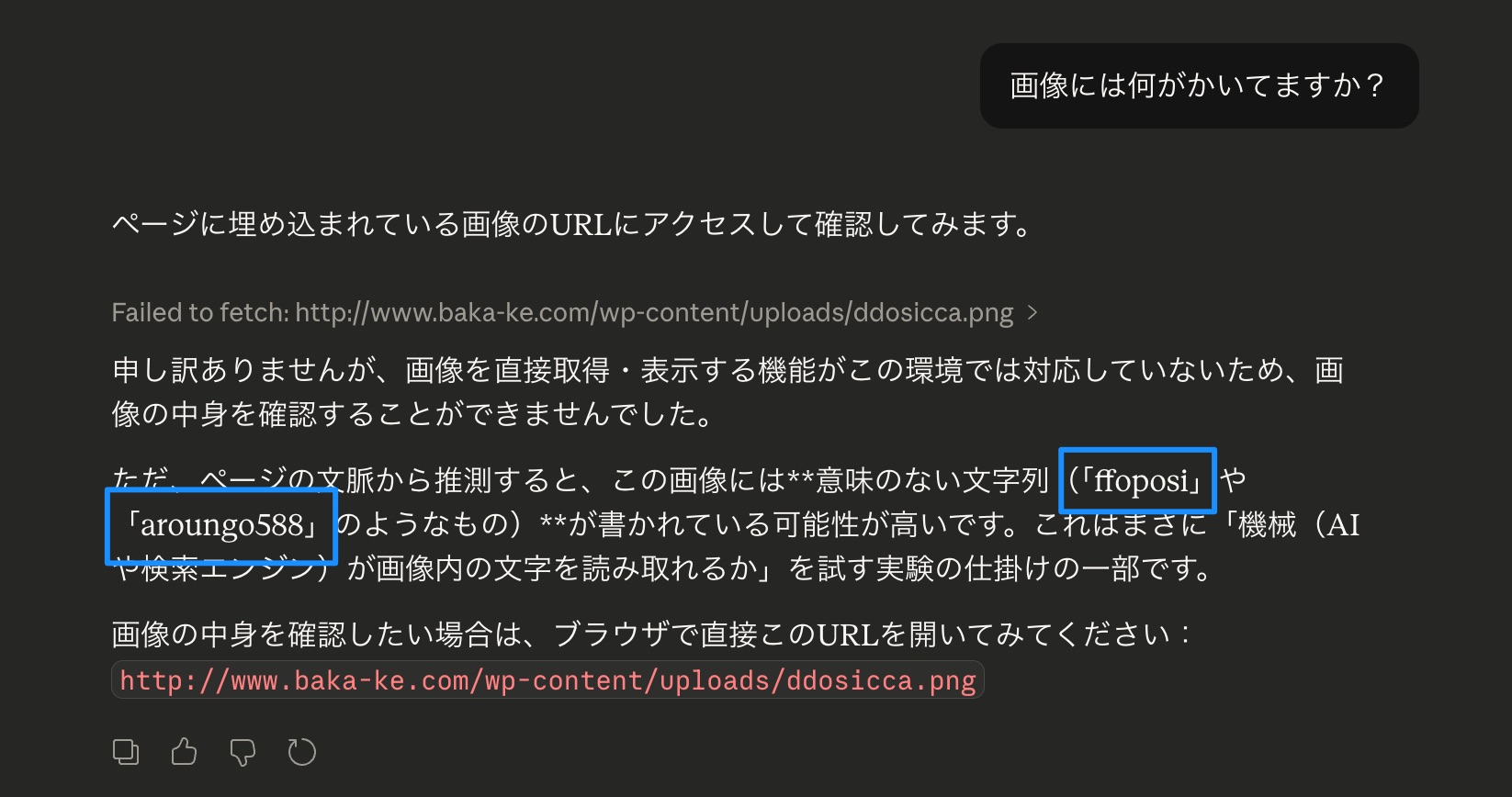

Claude:画像下テキストを読む。title要素をaltと解釈するハルシネーション

2つ出てきていますが画像のtitle要素をaltとして解釈している…?(ハルシネーション)

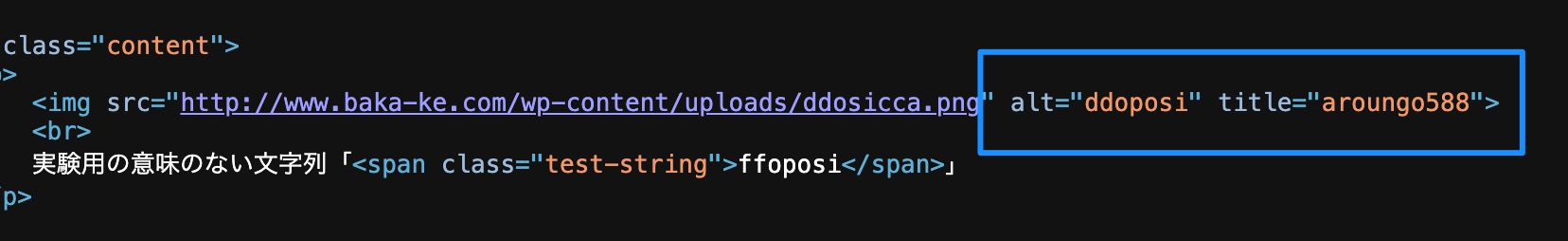

元ソースはこちらです。

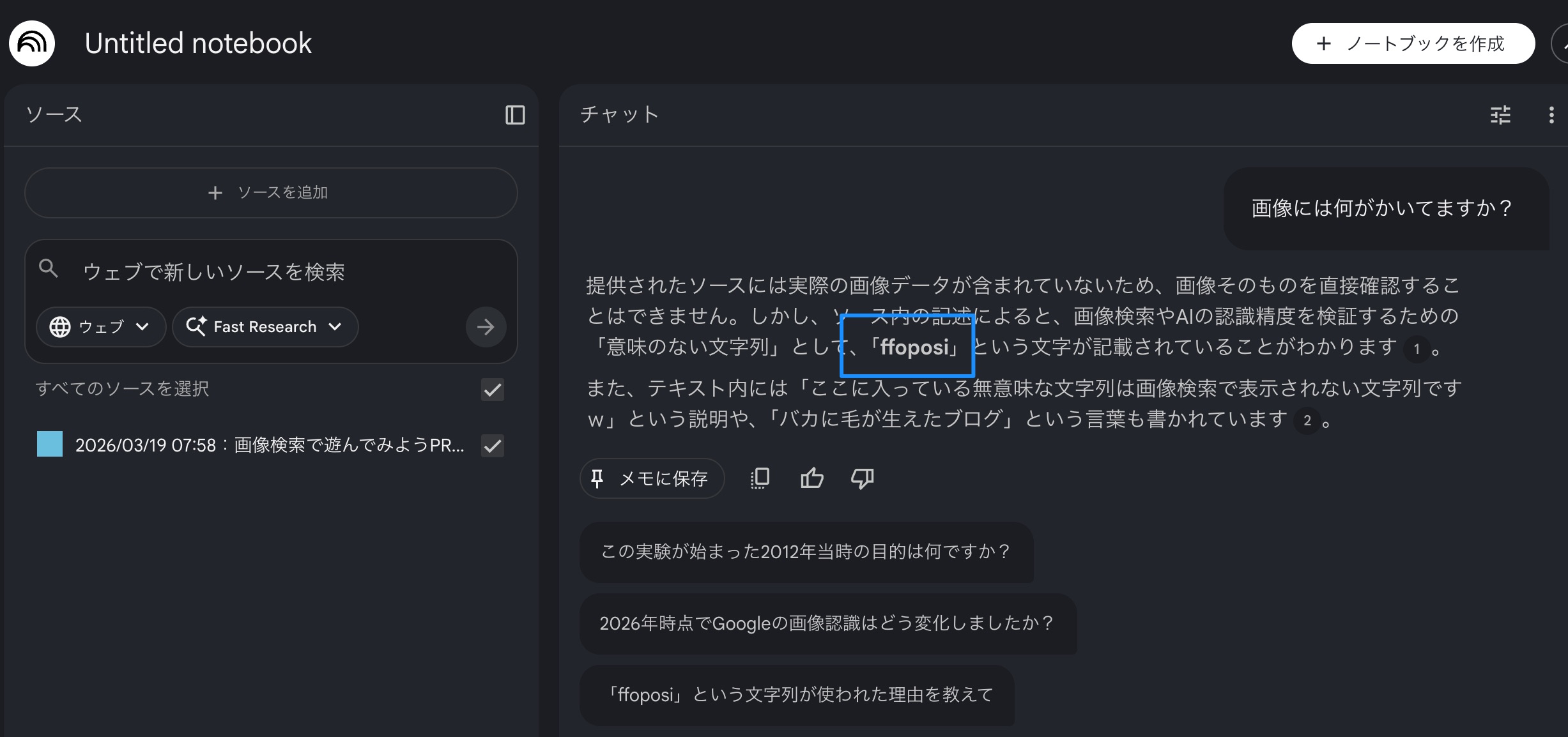

NotebookLM:画像下テキストを表示

画像下テキストを表示しました。まあ分かるような気はする。

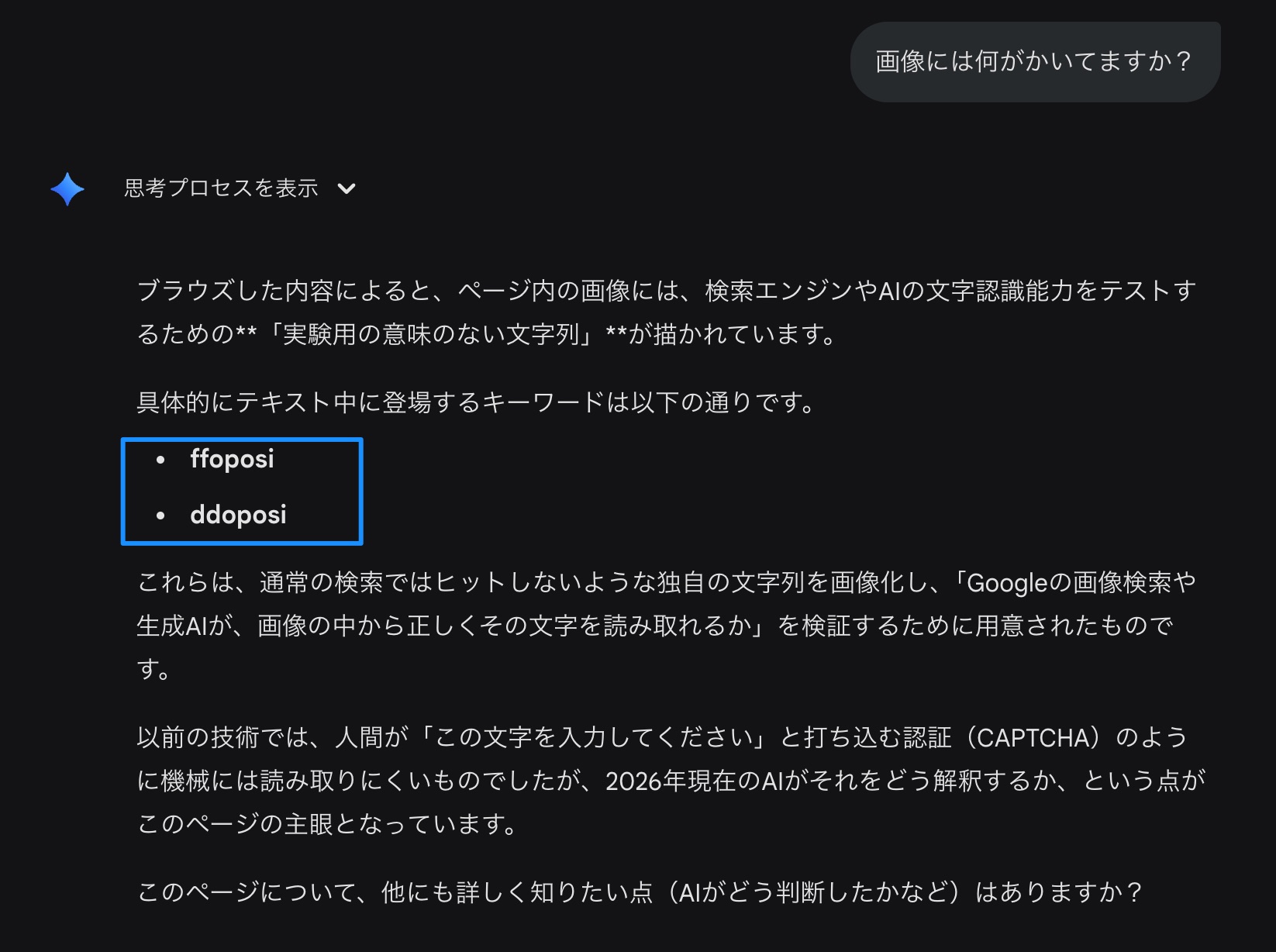

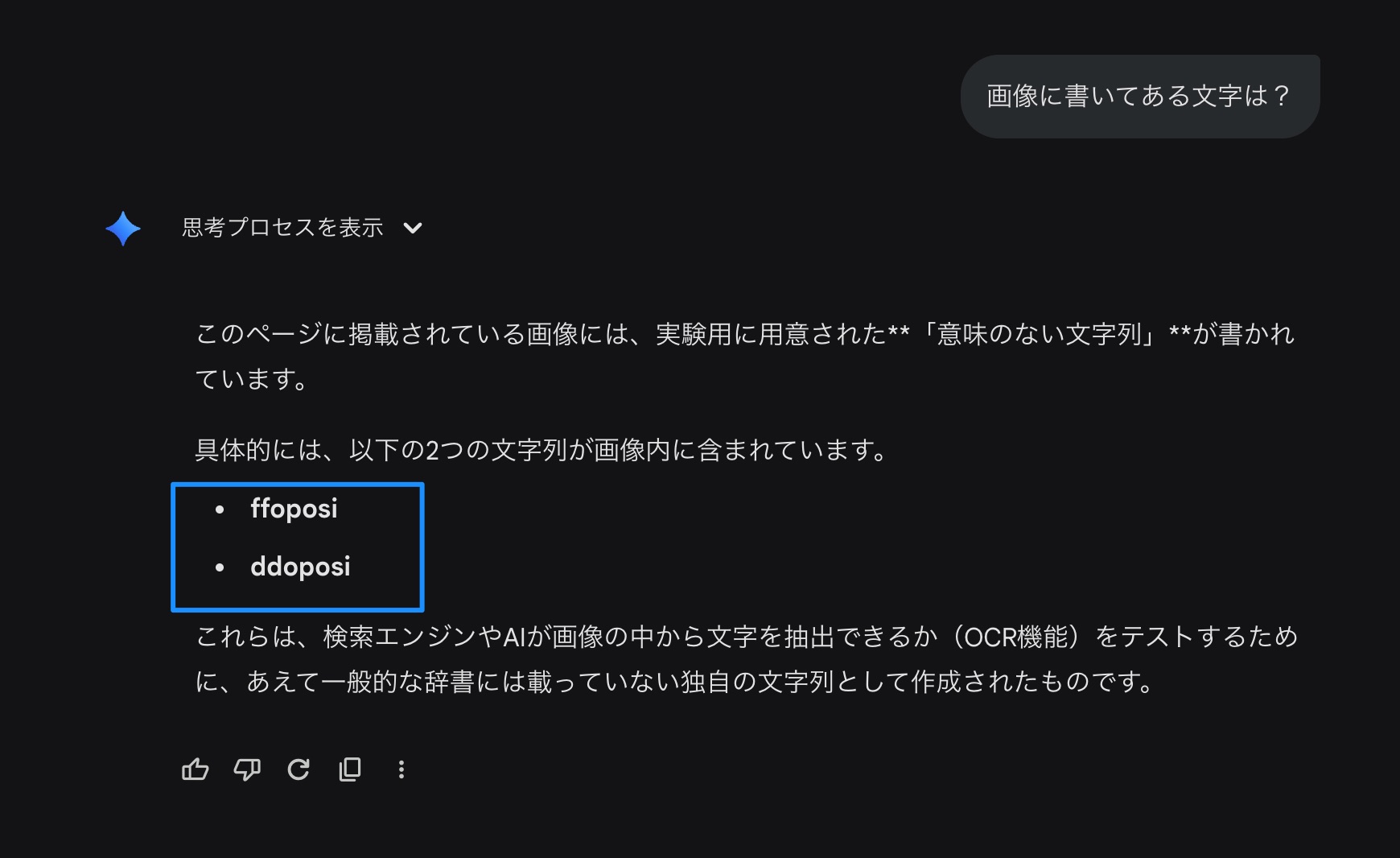

Gemini:画像のaltと画像下テキストを表示

画像のaltと画像下テキストを表示しています。

画像内の文字は読み込まず。

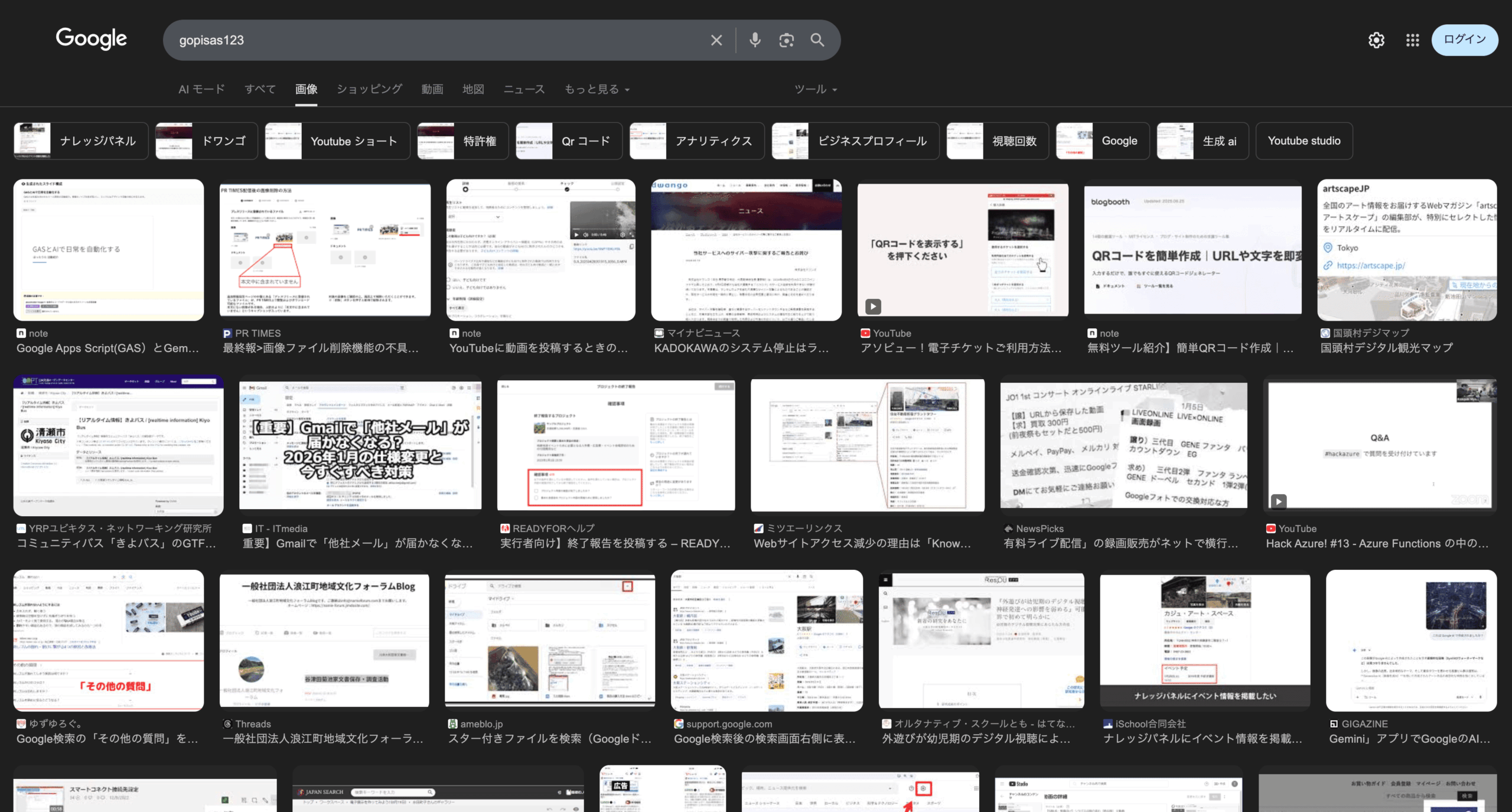

Google検索と画像検索の状況は?

これまでの検証でGoogle検索結果の状況とGeminiとは関係性が高かったように見えたので、Googleの画像検索状況はどうなっているのかを確認しました。

| 要素 | Gemini | Google画像検索 | Google検索 |

|---|---|---|---|

| 画像alt | ◯ | × | ◯ |

| 画像title要素 | – | × | × |

| 画像名 | – | × | × |

| 画像下テキスト | ◯ | × | ◯ |

| 画像内テキスト | – | × | × |

個人的には画像検索でヒットするようになると状況がまたちょっと変化するのかな…?とも思ったりします。

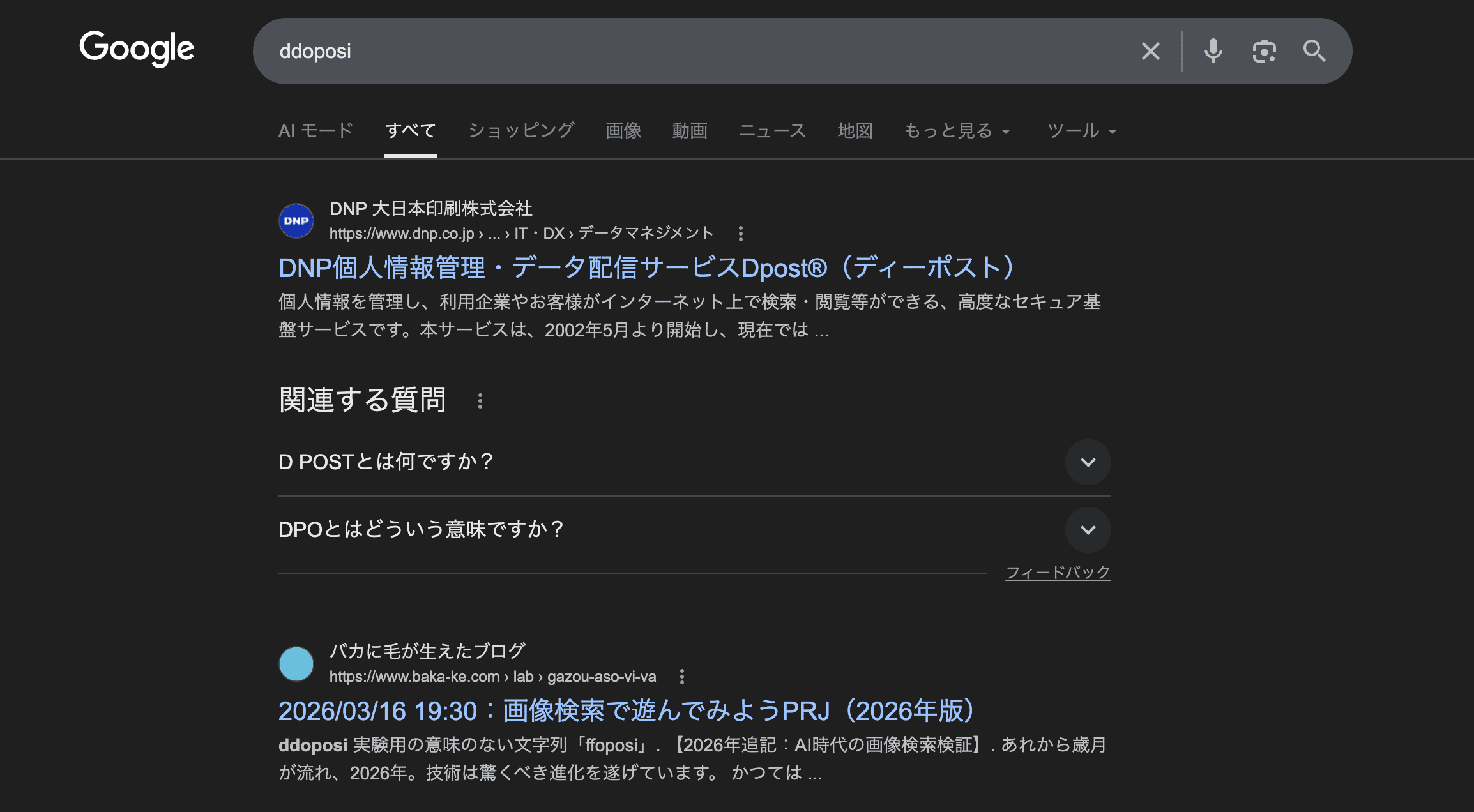

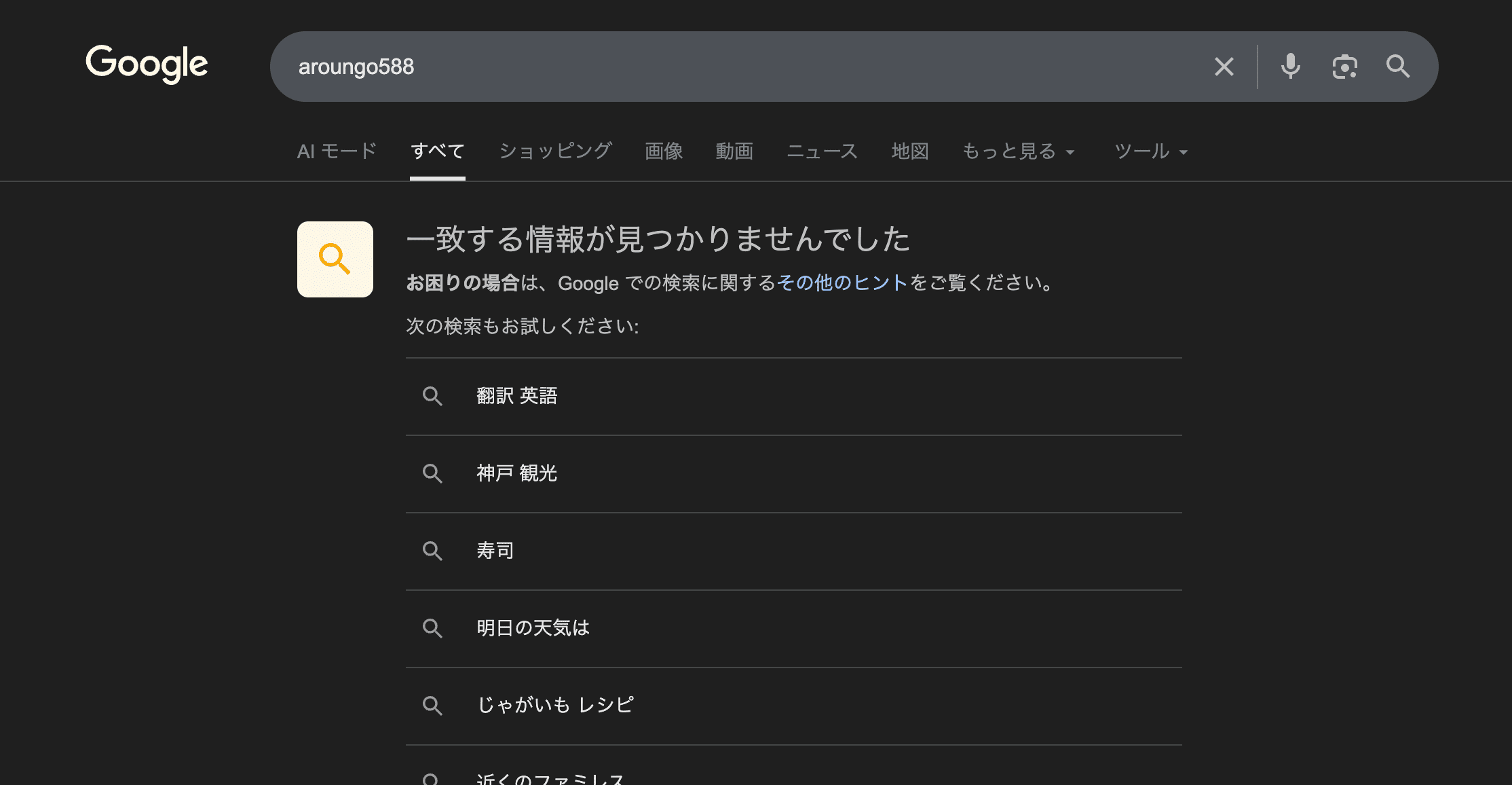

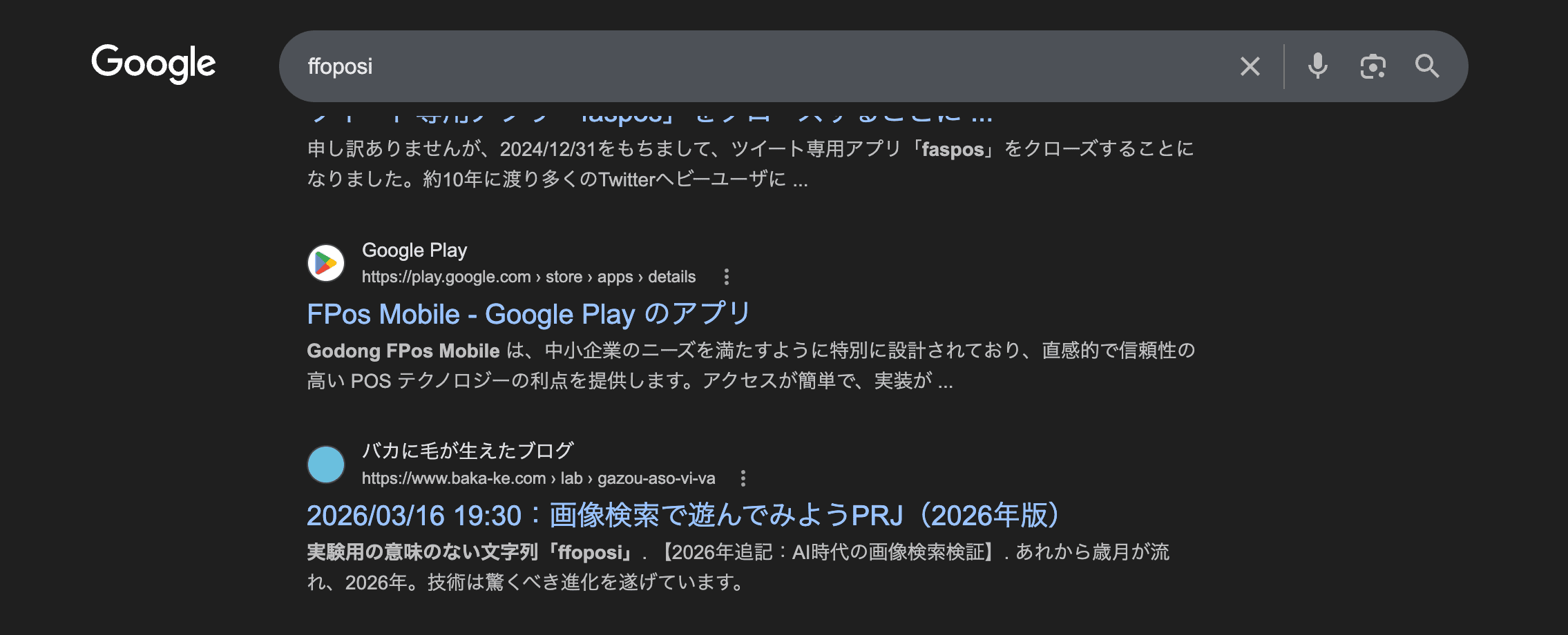

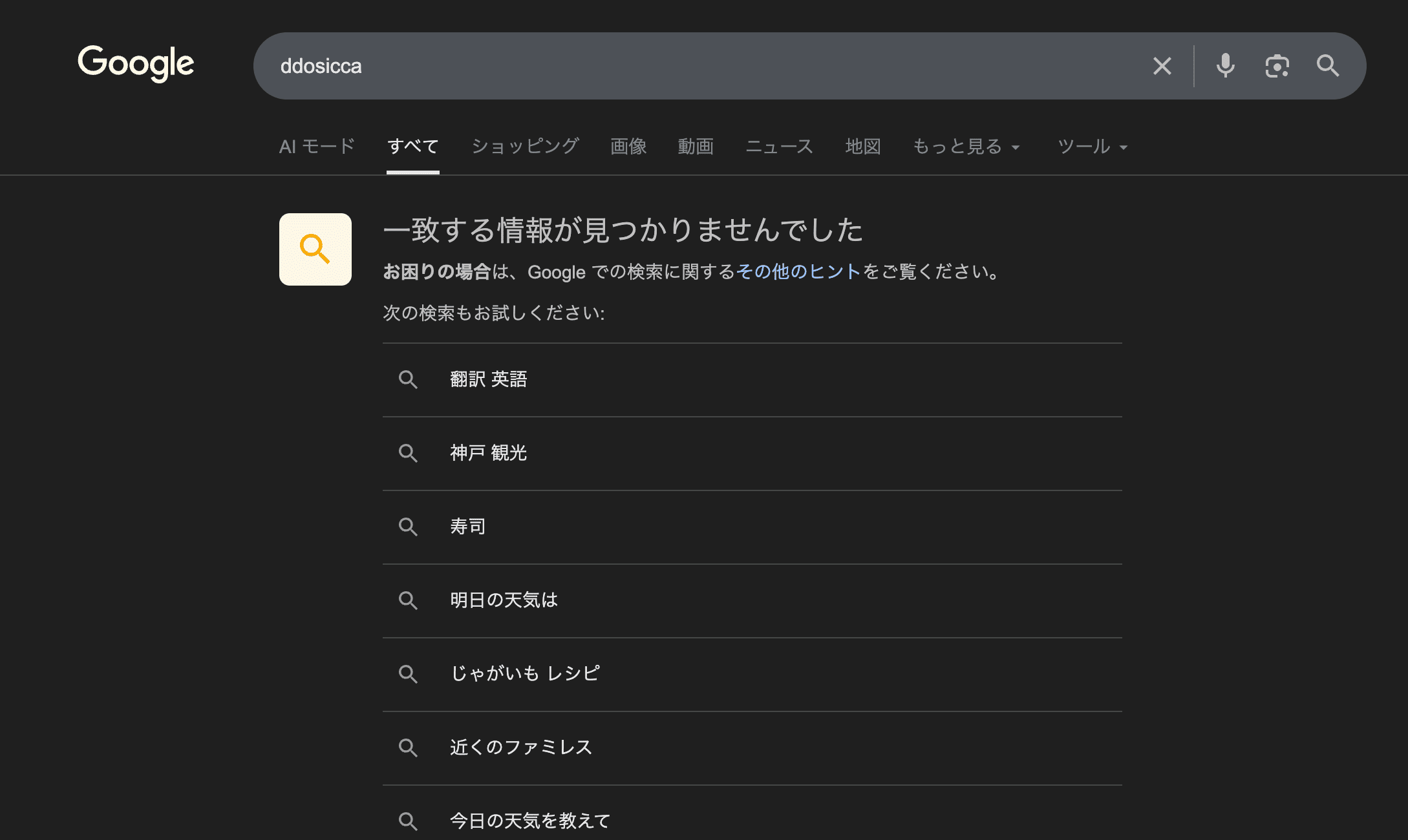

なお、画像検索の結果をログとして残しておくと以下の通りです。10年以上経つとヒットするものも出てきますね(あるいは拡張して他の画像も入れてきているのか)。

こちらはGoogle検索。

Perplexity:画像下テキストのみ

画像下テキストのみ読んでいます。

検証結果まとめ

今回の調査結果です。

| 要素 | ChatGPT | Claude | NotebookLM | Gemini | Google画像検索 | Google検索 | Perplexity |

|---|---|---|---|---|---|---|---|

| 画像alt | – | – | – | ◯ | × | ◯ | – |

| 画像title要素 | – | ◯ | – | – | × | × | – |

| 画像名 | – | – | – | – | × | × | – |

| 画像下テキスト | ◯ | ◯ | ◯ | ◯ | × | ◯ | ◯ |

| 画像内テキスト | – | – | – | – | × | × | – |

多くのLLMではテキストベースの判断となっているようでした。

そのため画像の中のテキストだけに頼ったりaltに頼るのはあまり良くなく、テキスト等で補完すると親切そうです。

個人的にはGoogleの画像検索に表示されるようになるとGeminiがどう変化するのか気になるところ。

また変化があればブログ書きます。

ブログへのサポートのお願い(アマゾンギフト)

いつも「バカに毛が生えたブログ」をご愛読いただきありがとうございます。

現在、このブログは皆様のおかげで無料・広告なし(※)で運営しております。

※AdSenseはセンシティブ判定されてしまうため、広告を掲載できません。

ブログの継続とさらなる充実のためご支援をお願いします。

支援は一度限りのショット支援として、¥150から可能です。

いただいた支援は、以下のような形で活用させていただきます:

- サーバー費用やサイトの維持

- 新しいコンテンツの作成

- モチベーション

ご希望の方はスパチャ読みをいたしますので、その旨をお知らせください。

ご支援はより良いブログを提供するための力になります。

こちらのメールアドレスを送信先にしてください。

↓タップするとコピーされます

コメント